Inicio > Proyectos > Santalucía

Santalucía

- FEB 2020

¿De qué va esto?

El reto era crear una nueva experiencia de usuario por voz usando inteligencia artificial (IA) tanto para dar de alta siniestros de hogar como para realizar segundas comunicaciones, y posicionar así a Santalucía como una empresa innovadora. Ya tienen una aplicación móvil llamada iHogar para la gestión de los siniestros donde debíamos integrar nuestro asistente virtual. Uno de los mayores retos fue tener que descomponer y rearmar las categorías de los siniestros existentes para hacer la experiencia por voz natural y simple, sin posibilidad de alterar las categorías para no afectar a los procesos actuales de la empresa. Todo ello se debía realizar en 2 meses con un equipo de 4 personas, a lo que le siguió un tiempo de depuración y pruebas para ajustar los últimos retoques.

El proceso.

Empezamos con UX Research.

Cuando conocimos este proyecto, lo primero que hice fue hacer un Benchmarking para conocer un poco más acerca del negocio de las aseguradoras, las aplicaciones que existían para gestionar los siniestros, tanto móviles como por voz, y participar en la experiencia de dar de alta un parte a través de la web de varias empresas.

Como nos gusta trabajar en Paradigma, comenzamos con un Sprint 0, en el que tomamos contacto con el cliente e intentamos profundizar más sobre el objetivo y alcance del proyecto y sentar las expectativas del proyecto. Así mismo, conocimos a nuestros usuarios objetivo, imaginamos cómo sería y cómo nos hablaría nuestro asistente virtual ideal y exploramos la aplicación actual, iHogar, con la que teníamos que integrarnos.

Hicimos una serie de dinámicas para conseguir toda esta información y plasmamos el viaje del usuario a través de esta nueva experiencia, lo que dió pie a imaginar los primeros esbozos del flujo de conversación. En paralelo, realizamos entrevistas y recopilamos información del uso de este tipo de aplicaciones, involucrando perfiles técnicos, de negocio y usuarios finales, a quienes también utilizamos para realizar pruebas de usuario.

Un baño de diseño conversacional.

Con estos primeros descubrimientos, empezamos a imaginar y validar los primeros scrpits o guiones que reflejaban cómo sería la interacción y los happy path o casos felices de las primeras conversaciones, que, se probaron con los usuarios, iterando una y otra vez, con el objetivo de mejorar y enriquecer la experiencia conversacional.

Descubrimos que el flujo actual de conversación visual y del call center no era el más óptimo y decidimos modificar el orden de las preguntas, evitando posibles dolores para el usuario en los casos innecesarios y haciendo las preguntas en el orden de relevancia para el usuario.

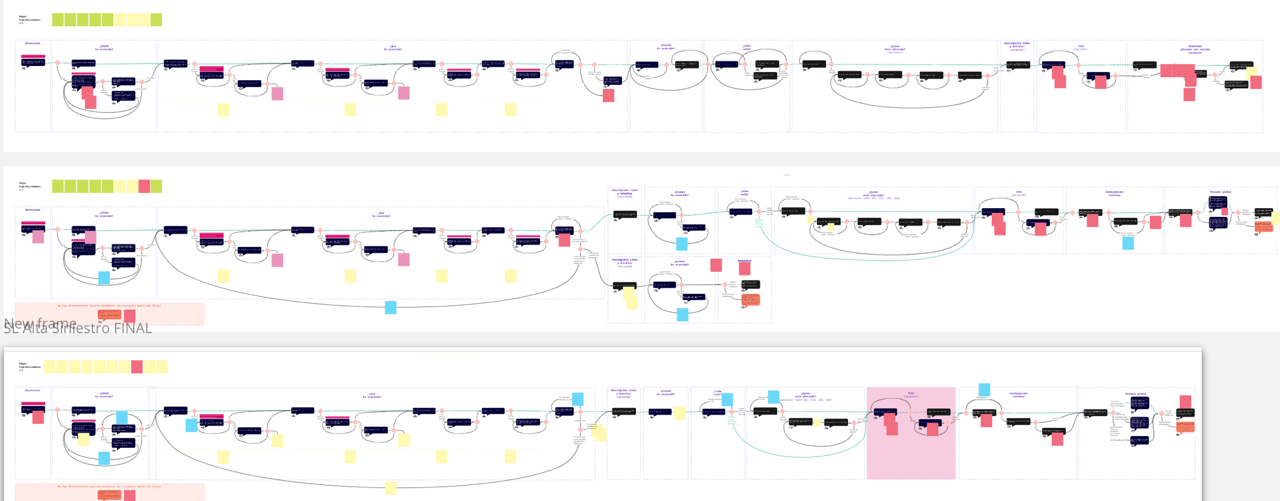

Los guiones validados con usuarios y negocio dieron paso a los primeros flujos de conversación donde ya se integraban las primeras desviaciones y no únicamente el caso feliz.

Nos enfrentamos a algunos problemas que se nos presentaban al pasar una interfaz gráfica a voz, como por ejemplo, que el usuario no podría enviar fotos de lo ocurrido, lo cual que tendría que hacer tras el alta del siniestro. La idea era hacer un flujo sencillo para el cliente y recoger los mínimos datos posibles para grabar el parte.

El gran reto de este proyecto fue adaptarnos a las más de 100 categorías ya existentes para los diferentes tipos de incidencias. Para ello, tuvimos que descomponerlas y volver a rehacerlas, esta vez agrupando por similaridad, de manera que mediante preguntas sencillas fuésemos descartando opciones hasta quedarnos con lo que el cliente necesita. ¡Un claro ejemplo del divide y vencerás!

La solución definitiva.

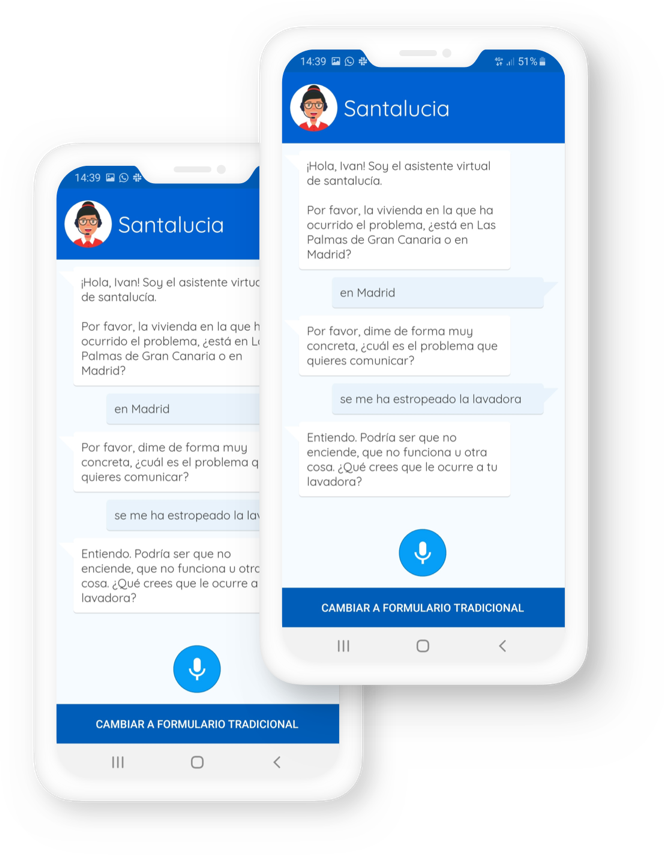

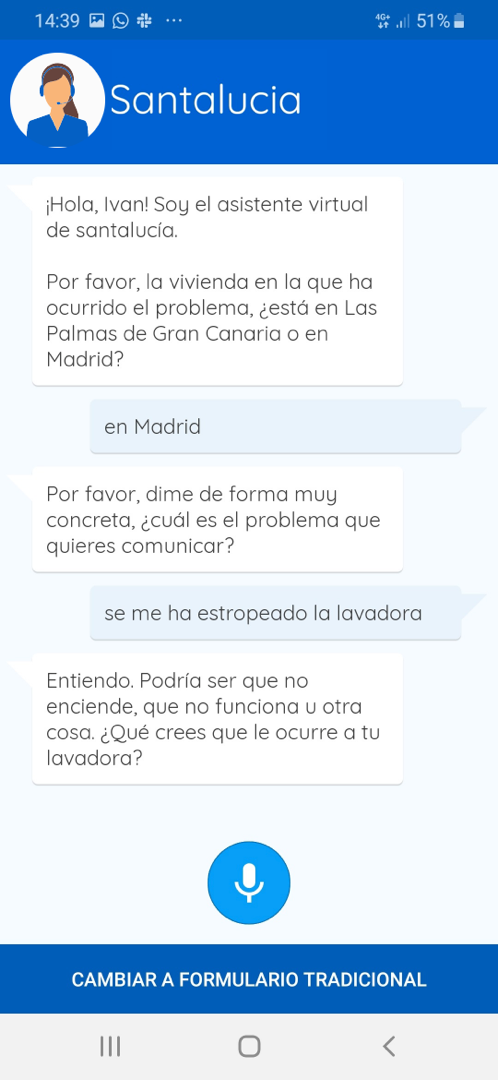

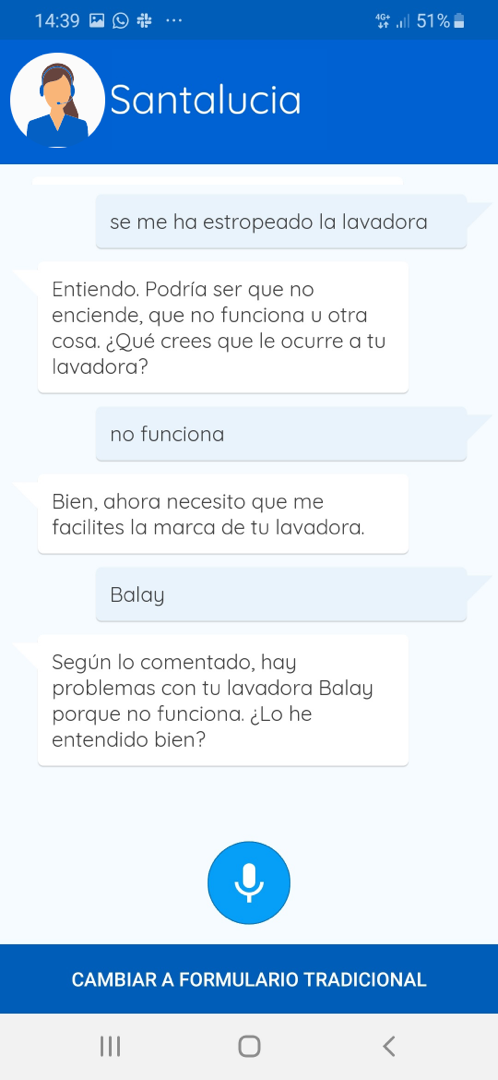

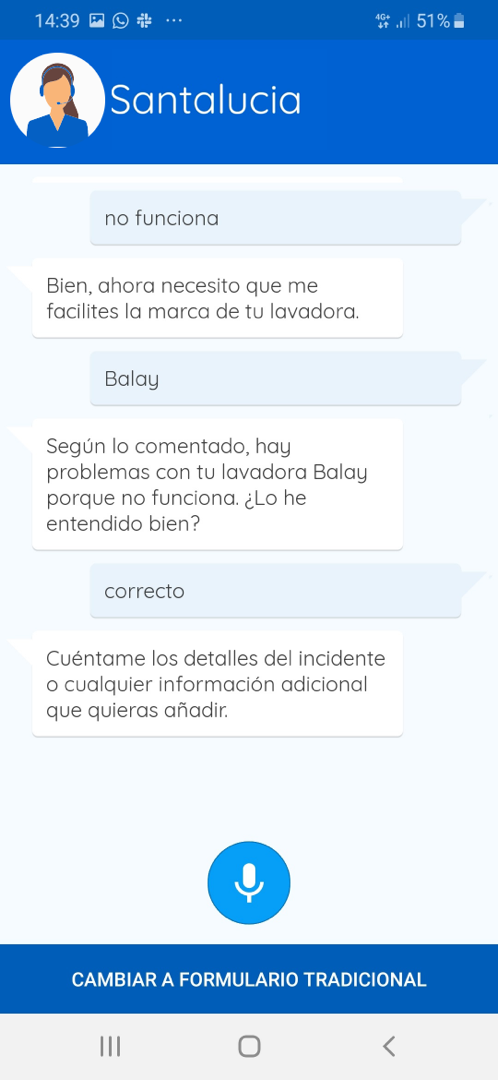

Durante el proyecto se decidió que el asistente virtual sería voice-first, basado 100% en voz, por lo que era necesario eliminar cualquier posibilidad para el usuario de poder escribir, ya que no se trataba de un chatbot. Sin embargo, al tener que acceder mediante la aplicación móvil, teníamos que diseñar una interfaz que permitiese al usuario la opción de realizar el proceso de forma gráfica o mediante la voz y que esa decisión fuese reversible en todo momento.

La interfaz es minimalista y del estilo de cualquier aplicación de mensajería a las que ya estamos acostumbrados. El botón principal es el micrófono, que cambia de color y se anima en función de si el usuario puede hablar porque el micrófono está activo o no, dando así un feedback visual al usuario de lo que puede hacer en todo momento.

Los resultados.

Uno de los miedos del proyecto era no afectar a la buena puntuación y opiniones que ya tenía en los market la aplicación actual de iHogar, tanto de Apple como de Google, y que tras unos meses en funcionamiento, pudimos confirmar que siguió siendo así. Además, sacamos algunas otras estadísticas y lo que obtuvimos fue:

+23.000

Mensajes intercambiados

en los 3 primeros meses.

447

Siniestros abiertos

en los 3 primeros meses.

+2.600

Usuarios activos

en los 3 primeros meses.

Lecciones aprendidas.

Cuando abordas un proyecto de innovación, sabes que vas a aprender muchas cosas y que te vas a equivocar en muchas otras. A nadie le gusta equivocarse, pero gracias a esos errores, apreendemos a ser mejores:

- Tuvimos que adaptar y crear algunas dinámicas para este tipo de proyectos con interfaces de voz.

- Sentamos unas bases y aprendimos cómo mejorar la metodología cuando abordemos nuevos proyectos.

- Hay que enseñar y aconsejar a los clientes, ya que desconocen muchas cosas de estas nuevas tecnologías como son las interfaces de voz, asistentes virtuales, chatbots... Nosotros estamos para acompañarles y ayudarles a construir una buena experiencia de usuario a través del diseño conversacional.

- Por supuesto, aprendimos mil cosas sobre Dialogflow y las tecnologías que utilizamos.

Enlaces de interés.

- Caso de éxito explicado en la web de Paradigma Digital.

- Santalucía incorpora el primer asistente de voz que ayuda en la tramitación de un siniestro.